What would totalitarian governments of the past have looked like if they were never defeated? The Nazis operated with 20th Century technology and it still took a world war to stop them.

How much more powerful – and permanent – could the Nazis have been if they had beat the US to the atomic bomb? Controlling the most advanced technology of the time could have solidified Nazi power and changed the course of history.

When we think of existential risks, events like nuclear war or asteroid impacts often come to mind.

Yet there’s one future threat that is less well known – and while it doesn’t involve the extinction of our species, it could be just as bad.

It’s called the “world in chains” scenario, where, like the preceding thought experiment, a global totalitarian government uses a novel technology to lock a majority of the world into perpetual suffering. If it sounds grim, you’d be right. But is it likely?

Researchers and philosophers are beginning to ponder how it might come about – and, more importantly, what we can do to avoid it.

Existential risks (x-risks) are disastrous because they lock humanity into a single fate, like the permanent collapse of civilisation or the extinction of our species.

These catastrophes can have natural causes, like an asteroid impact or a supervolcano, or be human-made from sources like nuclear war or climate change. Allowing one to happen would be “an abject end to the human story” and would let down the hundreds of generations that came before us, says Haydn Belfield, academic project manager at the Centre for the Study of Existential Risk at the University of Cambridge.

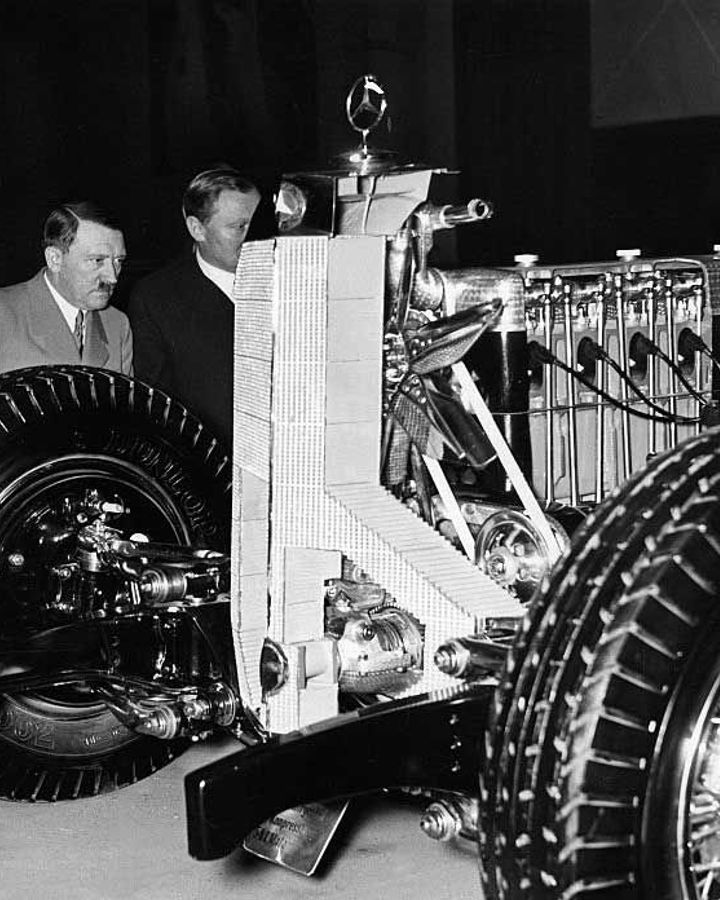

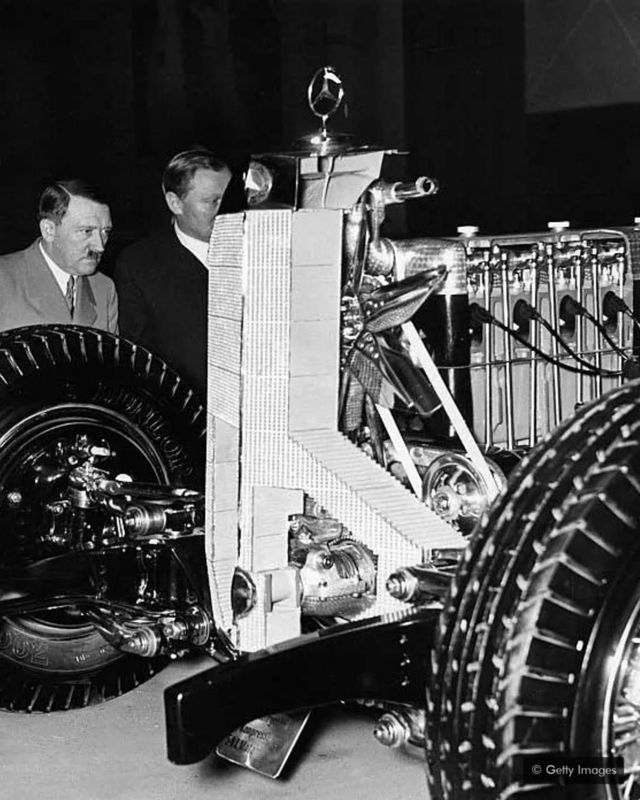

Hitler inspects advanced German engineering of the time – what if it had given the Nazis an unbeatable advantage? (Credit: Getty Images)

Toby Ord, a senior research fellow at the Future of Humanity Institute (FHI) at Oxford University, believes that the odds of an existential catastrophe happening this century from natural causes are less than one in 2,000, because humans have survived for 2,000 centuries without one.

However, when he adds the probability of human-made disasters, Ord believes the chances increase to a startling one in six. He refers to this century as “the precipice” because the risk of losing our future has never been so high.

Researchers at the Center on Long-Term Risk, a non-profit research institute in London, have expanded upon x-risks with the even-more-chilling prospect of suffering risks. These “s-risks” are defined as “suffering on an astronomical scale, vastly exceeding all suffering that has existed on Earth so far.” In these scenarios, life continues for billions of people, but the quality is so low and the outlook so bleak that dying out would be preferable. In short: a future with negative value is worse than one with no value at all.

This is where the “world in chains” scenario comes in. If a malevolent group or government suddenly gained world-dominating power through technology, and there was nothing to stand in its way, it could lead to an extended period of abject suffering and subjugation. A 2017 report on existential risks from the Global Priorities Project, in conjunction with FHI and the Ministry for Foreign Affairs of Finland, warned that “a long future under a particularly brutal global totalitarian state could arguably be worse than complete extinction”.

Singleton hypothesis

Though global totalitarianism is still a niche topic of study, researchers in the field of existential risk are increasingly turning their attention to its most likely cause: artificial intelligence.

In his “singleton hypothesis”, Nick Bostrom, director at Oxford’s FHI, has explained how a global government could form with AI or other powerful technologies – and why it might be impossible to overthrow. He writes that a world with “a single decision-making agency at the highest level” could occur if that agency “obtains a decisive lead through a technological breakthrough in artificial intelligence or molecular nanotechnology”.

Once in charge, it would control advances in technology that prevent internal challenges, like surveillance or autonomous weapons, and, with this monopoly, remain perpetually stable.

A nuclear missile on display in China (Credit: Getty Images)

If the singleton is totalitarian, life would be bleak.

Even in the countries with the strictest regimes, news leaks in and out from other countries and people can escape. A global totalitarian rule would eliminate even these small seeds of hope.

To be worse than extinction, “that would mean we feel absolutely no freedom, no privacy, no hope of escaping, no agency to control our lives at all”, says Tucker Davey, a writer at the Future of Life Institute in Massachusetts, which focuses on existential risk research.

“In totalitarian regimes of the past, [there was] so much paranoia and psychological suffering because you just have no idea if you’re going to get killed for saying the wrong thing,” he continues. “And now imagine that there’s not even a question, every single thing you say is being reported and being analysed.”

“We may not yet have the technologies to do this,” Ord said in a recent interview, “but it looks like the kinds of technologies we’re developing make that easier and easier. And it seems plausible that this may become possible at some time in the next 100 years.”

AI and authoritarianism

Though life under a global totalitarian government is still an unlikely and far-future scenario, AI is already enabling authoritarianism in some countries and strengthening infrastructure that could be seized by an opportunistic despot in others.

“We’ve seen sort of a reckoning with the shift from very utopian visions of what technology might bring to much more sobering realities that are, in some respects, already quite dystopian,” says Elsa Kania, an adjunct senior fellow at the Center for New American Security, a bipartisan non-profit that develops national security and defence policies.

A benevolent government that installs surveillance cameras everywhere could make it easier for a totalitarian one to rule in the future (Credit: Steffi Loos/Getty Images)

In the past, surveillance required hundreds of thousands of people – one in every 100 citizens in East Germany was an informant – but now it can be done by technology. In the United States, the National Security Agency (NSA) collected hundreds of millions of American call and text records before they stopped domestic surveillance in 2019, and there are an estimated four to six million CCTV cameras across the United Kingdom. Eighteen of the 20 most surveilled cities in the world are in China, but London is the third. The difference between them lies less in the tech that the countries employ and more in how they use it.

What if the definition of what is illegal in the US and the UK expanded to include criticising the government or practising certain religions? The infrastructure is already in place to enforce it, and AI – which the NSA has already begun experimenting with – would enable agencies to search through our data faster than ever before.

In addition to enhancing surveillance, AI also underpins the growth of online misinformation, which is another tool of the authoritarian. AI-powered deep fakes, which can spread fabricated political messages, and algorithmic micro-targeting on social media are making propaganda more persuasive. This undermines our epistemic security – the ability to determine what is true and act on it – that democracies depend on.

“Over the last few years, we’ve seen the rise of filter bubbles and people getting shunted by various algorithms into believing various conspiracy theories, or even if they’re not conspiracy theories, into believing only parts of the truth,” says Belfield.

“You can imagine things getting much worse, especially with deep fakes and things like that, until it’s increasingly harder for us to, as a society, decide these are the facts of the matter, this is what we have to do about it, and then take collective action.”

Preemptive measures

The Malicious Use of Artificial Intelligence report, written by Belfield and 25 authors from 14 institutions, forecasts that trends like these will expand existing threats to our political security and introduce new ones in the coming years. Still, Belfield says his work makes him hopeful and that positive trends, like more democratic discussions around AI and actions by policy-makers (for example, the EU considering pausing facial recognition in public places), keep him optimistic that we can avoid catastrophic fates.

Davey agrees. “We need to decide now what are acceptable and unacceptable uses of AI,” he says. “And we need to be careful about letting it control so much of our infrastructure. If we’re arming police with facial recognition and the federal government is collecting all of our data, that’s a bad start.”

If you remain sceptical that AI could offer such power, consider the world before nuclear weapons.

Three years before the first nuclear chain reaction, even scientists trying to achieve it believed it was unlikely.

Humanity, too, was unprepared for the nuclear breakthrough and teetered on the brink of “mutually assured destruction” before treaties and agreements guided the global proliferation of the deadly weapons without an existential catastrophe.

We can do the same with AI, but only if we combine the lessons of history with the foresight to prepare for this powerful technology.

The world may not be able to stop totalitarian regimes like the Nazis rising again in the future – but we can avoid handing them the tools to extend their power indefinitely.

—

Mục lục

Trí tuệ nhân tạo sẽ biến cả loài người thành nô lệ của độc tài?

- Di Minardi

- BBC Future

GETTY IMAGES

Các chính phủ độc tài trước đây sẽ như thế nào nếu họ không bao giờ bị đánh bại?

Đức Quốc xã chỉ dùng công nghệ của thế kỷ 20 thôi mà vẫn phải cần một cuộc chiến tranh thế giới mới ngăn được họ.

Đức Quốc xã có thể hùng mạnh đến mức nào và tồn tại lâu tới khi nào nếu họ đánh bại Mỹ trong lĩnh vực bom nguyên tử?

Việc kiểm soát công nghệ tân tiến nhất thời đó lẽ ra đã có thể củng cố sức mạnh của Đức Quốc xã và làm thay đổi tiến trình lịch sử.

Rủi ro sinh tồn

Khi nghĩ đến những rủi ro sinh tồn, trong tâm trí chúng ta thường nghĩ đến các biến cố như chiến tranh hạt nhân hoặc Trái Đất va chạm vào tiểu hành tinh.

Tuy nhiên, có một mối đe dọa trong tương lai ít được biết đến hơn – mặc dù nó không phải là sẽ dẫn đến sự tuyệt chủng của loài người, nhưng hậu quả cũng thảm khốc không kém.

Đó là kịch bản ‘thế giới bị gông cùm’ mà ở đó, giống như trong thử nghiệm tư tưởng trước đó, một nhà nước toàn trị toàn cầu sử dụng một công nghệ hoàn toàn mới để đưa phần lớn nhân loại vào nỗi thống khổ triền miên.

Nếu nó nghe có vẻ ảm đạm đối với bạn, thì đúng thật như vậy. Nhưng nó có khả năng xảy ra không?

Các nhà nghiên cứu và triết gia đang bắt đầu suy ngẫm xem kịch bản đó có thể xảy ra như thế nào – và quan trọng hơn, phải làm gì để tránh điều đó xảy ra.

Rủi ro sinh tồn (x-risk) là thảm họa vì chúng đẩy nhân loại vào một số phận duy nhất, giống như sự sụp đổ vĩnh viễn của nền văn minh hoặc sự tuyệt chủng của loài người chúng ta.

Những thảm họa này có thể do nguyên nhân tự nhiên, chẳng hạn như bị va chạm vào thiên thạch hay siêu núi lửa phun trào, hoặc nguyên nhân nhân tạo từ các nguồn như chiến tranh hạt nhân hay biến đổi khí hậu.

Để cho thảm họa kiểu đó xảy ra sẽ là “một kết thúc không tốt đẹp cho loài người” và sẽ làm thất vọng hàng trăm thế hệ từng sống trước chúng ta, Haydn Belfield, giám đốc dự án học thuật tại Trung tâm Nghiên cứu Rủi ro Sinh tồn thuộc Đại học Cambridge, cho biết.

GETTY IMAGES Hitler kiểm tra công nghệ tân tiến của Đức thời đó – điều gì đã có thể xảy ra nếu Đức Quốc xã đã đạt được những thành tựu khoa học, kỹ thuật, công nghệ tiến bộ vượt bậc, không nước nào so được?

Toby Ord, một nhà nghiên cứu cấp cao tại Viện Tương lai Nhân loại (FHI) thuộc Đại học Oxford, tin rằng khả năng xảy ra một thảm họa sinh tồn trong thế kỷ này do các nguyên nhân tự nhiên là chưa đến một phần 2.000, bởi vì con người đã sống sót qua 2.000 thế kỷ mà không có một biến cố như thế.

Tuy nhiên, khi thêm xác suất xảy ra các thảm họa do con người tạo ra, Ord tin rằng khả năng sẽ tăng đến tỷ lệ giật mình, ở mức một phần sáu.

Ông gọi thế kỷ này là ‘vách núi’ vì nguy cơ chúng ta đánh mất tương lai chưa bao giờ cao đến thế.

Các nhà nghiên cứu tại Trung tâm Rủi ro Dài hạn, một viện nghiên cứu phi lợi nhuận ở London, đã mở rộng ‘rủi ro x‘ với viễn cảnh thậm chí còn rùng rợn hơn về nỗi thống khổ.

Những ‘rủi ro s‘ này được định nghĩa là ‘sự đau khổ ở quy mô lớn, vượt xa tất cả những đau khổ có mặt trên Trái Đất cho đến nay.’

Trong những tình huống này, cuộc sống vẫn tiếp diễn đối với hàng tỷ người, nhưng chất lượng cuộc sống thấp và triển vọng ảm đạm đến mức chết dần chết mòn còn tốt hơn là sống.

Nói tóm lại: tương lai với giá trị xấu còn tệ hơn tương lai không có giá trị nào cả.

Đó là lúc kịch bản ‘thế giới bị gông cùm’ xuất hiện. Nếu một nhóm hoặc chính phủ ác độc đột nhiên giành được quyền lực thống trị thế giới bằng công nghệ và không có gì cản được họ, điều đó có thể dẫn đến thời gian dài đau khổ và tuân phục.

Phúc trình năm 2017 về những rủi ro sinh tồn từ Dự án Ưu tiên Toàn cầu, được phối hợp thực hiện giữa FHI và Bộ Ngoại giao Phần Lan, cảnh báo rằng “tương lai dài dưới một chế độ toàn trị toàn cầu đặc biệt tàn bạo có thể còn tồi tệ hơn là việc nhân loại bị tuyệt diệt”.

Giả thuyết độc nhất

Mặc dù chủ nghĩa toàn trị toàn cầu vẫn còn là một chủ đề nghiên cứu bỏ ngỏ, nhưng các nhà nghiên cứu về rủi ro sinh tồn đang ngày càng chú ý đến nguyên nhân khả dĩ nhất: trí tuệ nhân tạo.

Trong ‘giả thuyết độc nhất’, Nick Bostrom, giám đốc Viện FHI thuộc Đại học Oxford, đã giải thích làm thế nào một chính phủ toàn cầu có thể hình thành bằng AI hoặc các công nghệ lợi hại khác – và làm thế nào mà nó không thể bị lật đổ.

Ông viết rằng thế giới với “một cơ quan ra quyết định duy nhất ở cấp cao nhất” có thể trở thành hiện thực nếu cơ quan đó “có được sự dẫn đầu mang tính quyết định nhờ vào đột phá công nghệ trong trí tuệ nhân tạo hoặc công nghệ nano phân tử”.

Sau khi lên nắm quyền, nó sẽ kiểm soát những tiến bộ công nghệ nhằm ngăn chặn những thách thức từ bên trong, chẳng hạn như giám sát hay vũ khí tự động, và với sự độc chiếm quyền hành này, nó sẽ ổn định vĩnh viễn.

GETTY IMAGES Một tên lửa hạt nhân được trưng bày tại Trung Quốc

Nếu cơ quan đơn nhất đó mang tính toàn trị, cuộc sống sẽ thật ảm đạm.

Cho đến nay, ngay cả ở những quốc gia có chế độ cai trị khắc nghiệt nhất, tin tức vẫn có thể rò rỉ vào hoặc ra từ các quốc gia khác và mọi người có thể trốn thoát. Một chế độ toàn trị toàn cầu sẽ loại bỏ ngay cả những hạt giống hy vọng nhỏ nhoi này.

Còn tệ hơn cả sự tuyệt diệt, “điều đó có nghĩa là chúng ta hoàn toàn không cảm thấy tự do nào cả, không có sự riêng tư nào cả, không có hy vọng trốn thoát, không có cơ quan nào kiểm soát cuộc sống của chúng ta”, Tucker Davey, một cây viết tại Viện Tương lai Cuộc sống ở Massachusetts, vốn tập trung vào nghiên cứu rủi ro sinh tồn, cho biết.

“Trong các chế độ toàn trị trước đây, [có] quá nhiều sự hoang tưởng và đau khổ tâm lý bởi vì bạn không biết liệu mình có bị giết vì nói điều gì đó sai hay không,” ông nói tiếp. “Và bây giờ hãy tưởng tượng rằng thậm chí còn không cần đến một câu hỏi nào, mỗi điều bạn nói sẽ được báo cáo và phân tích.”

“Chúng ta có thể chưa có công nghệ để làm điều này,” Ord cho biết trong một cuộc phỏng vấn mới đây, “nhưng có vẻ như các dạng công nghệ mà chúng ta đang phát triển đang làm cho điều đó ngày càng trở nên dễ thực hiện. Và điều này có thể trở nên khả dĩ trong vòng 100 năm tới.”

Trí tuệ nhân tạo và chế độ chuyên chế

Mặc dù cuộc sống dưới một chính quyền toàn trị toàn cầu vẫn là một viễn cảnh khó xảy ra và còn ở trong tương lai xa, nhưng trí tuệ nhân tạo (AI) đã tạo điều kiện cho chế độ chuyên chế ở một số quốc gia và củng cố cơ sở hạ tầng ở những quốc gia khác vốn có thể bị những kẻ chuyên chế chiếm lấy.

“Chúng ta đã chứng kiến việc chuyển dịch nhận thức, từ chỗ có những tầm nhìn rất hoang tưởng đối với những gì công nghệ có thể tạo ra, cho đến thực tế đáng sợ là trong một số khía cạnh thì những gì chúng tạo ra rất có thể lại là cuộc sống địa ngục,” Elsa Kania, học giả cao cấp tại Trung tâm An ninh Mỹ Mới, tổ chức phi lợi nhuận lưỡng đảng vốn xây dựng các chính sách an ninh và quốc phòng quốc gia, cho biết.

GETTY IMAGES

Trước đây, việc giám sát đòi hỏi cần có hàng trăm nghìn người – cứ mỗi 100 công dân ở Đông Đức thì có một người chỉ điểm – nhưng giờ đây nó có thể được thực hiện bằng công nghệ.

Tại Mỹ, Cơ quan An ninh Quốc gia (NSA) đã thu thập dữ liệu của hàng trăm triệu cuộc gọi và tin nhắn của người Mỹ trước khi họ ngừng giám sát nội địa vào năm 2019, và ước tính có khoảng từ bốn đến sáu triệu camera theo dõi CCTV trên khắp nước Anh.

Mười tám trong số 20 thành phố bị giám sát nhiều nhất trên thế giới nằm ở Trung Quốc, nhưng London thì xếp hạng thứ ba. Sự khác biệt giữa chúng không phải ở công nghệ mà các nước sử dụng mà là cách họ sử dụng nó.

Điều gì sẽ xảy ra nếu định nghĩa về cái gì là bất hợp pháp ở Mỹ và Anh được mở rộng ra đến bao gồm việc chỉ trích chính phủ hoặc đi theo một tôn giáo nào đó? Đã có công nghệ để thực hành việc này và AI – mà NSA đã bắt đầu thử nghiệm – sẽ cho phép việc tìm kiếm lục lọi dữ liệu của chúng ta được thực hiện nhanh hơn bao giờ hết.

Bên cạnh giúp tăng cường giám sát, AI cũng tạo nền tảng cho sự nở rộ của thông tin sai lệch trên mạng, một công cụ khác của những kẻ độc tài.

Những thông tin siêu giả tạo do AI tạo dựng, vốn có thể lan truyền các thông điệp chính trị bịa đặt và nhắm vào các nhóm nhỏ trên mạng xã theo thuật toán, đang làm cho việc tuyên truyền trở nên thuyết phục hơn. Điều này làm suy yếu an ninh nhận thức của chúng ta – khả năng xác định điều gì là đúng và hành động dựa trên nó – điều mà các nền dân chủ dựa vào.

“Trong vài năm qua, chúng ta đã chứng kiến sự gia tăng của các bong bóng lọc và mọi người bị các thuật toán khác nhau dẫn dắt, khiến họ tin vào các thuyết âm mưu khác nhau, và thậm chí khi đó không phải là thuyết âm mưu thì nó cũng khiến cho người ta chỉ tin vào một phần sự thật,” Belfield cho biết.

“Bạn có thể tưởng tượng mọi thứ trở nên tồi tệ hơn nhiều, đặc biệt là những thông tin toàn giả toàn tập và đại loại thế, cho đến lúc ngày càng khó cho chúng ta, với tư cách là một xã hội, quyết định đây mới là sự thật của vấn đề, đây là những gì chúng ta phải làm với nó, và sau đó có hành động tập thể.”

Các biện pháp ngăn ngừa

Phúc trình Sử dụng Trí tuệ Nhân tạo Một cách độc hại, do Belfield và 25 tác giả từ 14 tổ chức viết, dự báo rằng các xu hướng như thế này sẽ mở rộng các mối đe dọa hiện có đến an ninh chính trị của chúng ta và đem đến những mối đe dọa mới trong những năm tới.

Tuy nhiên, Belfield cho biết công việc của ông khiến ông có hy vọng rằng những xu hướng tích cực, như các cuộc thảo luận dân chủ hơn về AI và hành động của các nhà hoạch định chính sách (chẳng hạn như việc EU đang xem xét tạm dừng nhận dạng khuôn mặt ở nơi công cộng), khiến ông lạc quan rằng chúng ta có thể tránh được số phận thảm khốc .

Davey đồng ý. “Chúng ta cần phải quyết định cách sử dụng AI nào được chấp nhận và cách nào không được chấp nhận ngay bây giờ,” ông nói. “Và chúng ta cần phải cẩn thận, không cho nó kiểm soát quá nhiều cơ sở hạ tầng của chúng ta. Nếu chúng ta trang bị cho cảnh sát khả năng nhận dạng khuôn mặt và chính phủ liên bang đang thu thập tất cả dữ liệu của chúng ta, đó là khởi đầu tồi.”

Nếu bạn vẫn còn nghi ngờ rằng AI có thể có quyền lực như vậy, hãy xem xét thế giới trước khi có vũ khí hạt nhân.

Ba năm trước khi xảy ra phản ứng dây chuyền hạt nhân đầu tiên, ngay cả các nhà khoa học cố gắng phát triển vũ khí hạt nhân cũng tin rằng điều đó khó có thể xảy ra.

Nhân loại cũng vậy, họ không chuẩn bị cho đột phá hạt nhân và loạng choạng trên bờ vực của ‘sự hủy diệt chắc chắn cho cả hai bên’ trước khi các hiệp ước và thỏa thuận hướng dẫn việc phổ biến thứ vũ khí chết chóc này trên toàn cầu mà không để xảy ra thảm họa sinh tồn.

Chúng ta có thể làm điều tương tự với AI, nhưng chỉ khi chúng ta kết hợp những bài học lịch sử với tầm nhìn trước để chuẩn bị cho công nghệ lợi hại này.

Thế giới có thể sẽ không thể ngăn chặn được các chế độ độc tài như Đức Quốc xã trỗi dậy trở lại trong tương lai – nhưng chúng ta có thể tránh giao đặt vào tay họ những công cụ để mở rộng quyền lực mãi mãi.

Bài tiếng Anh đã đăng trên BBC Future.